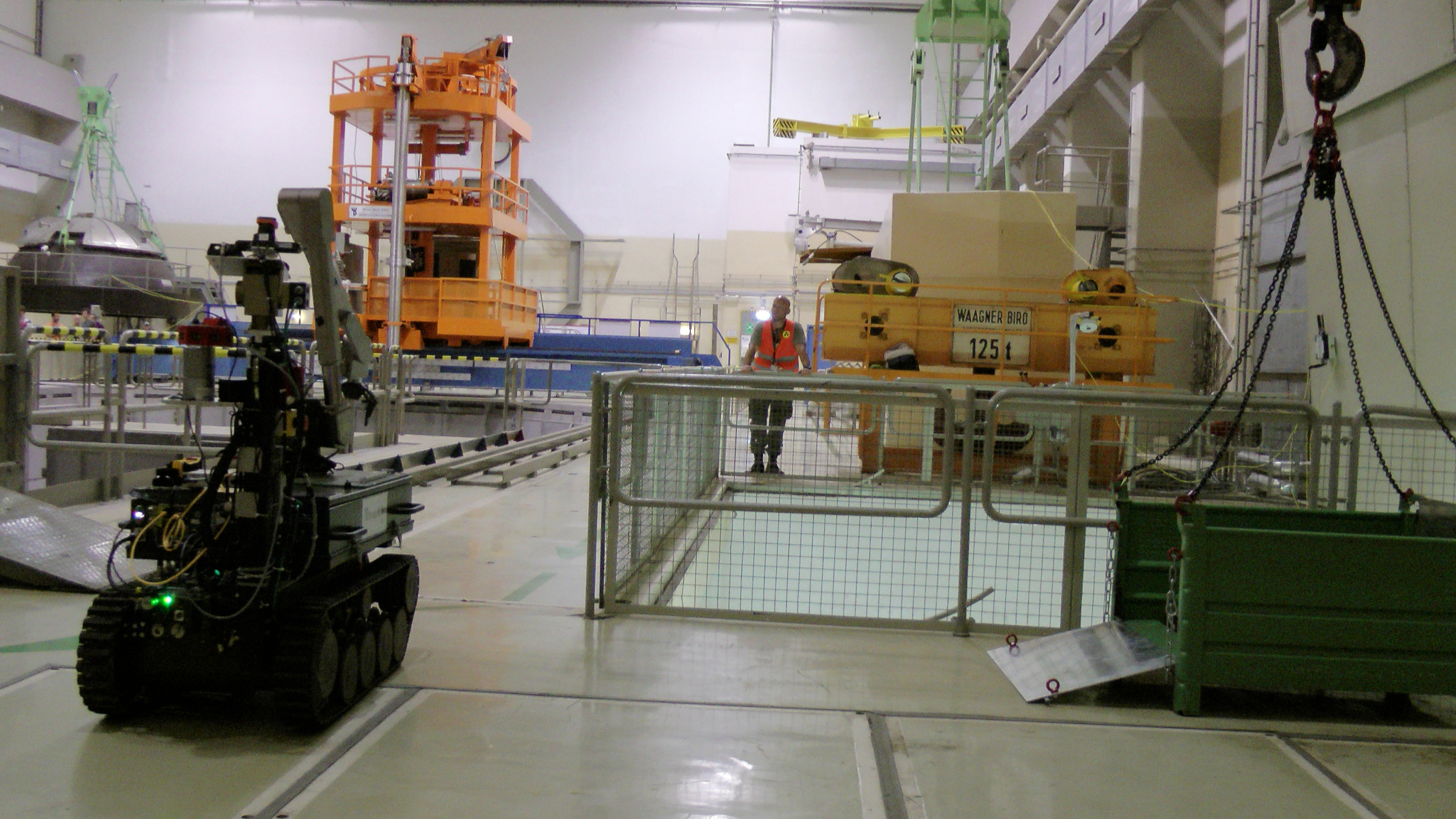

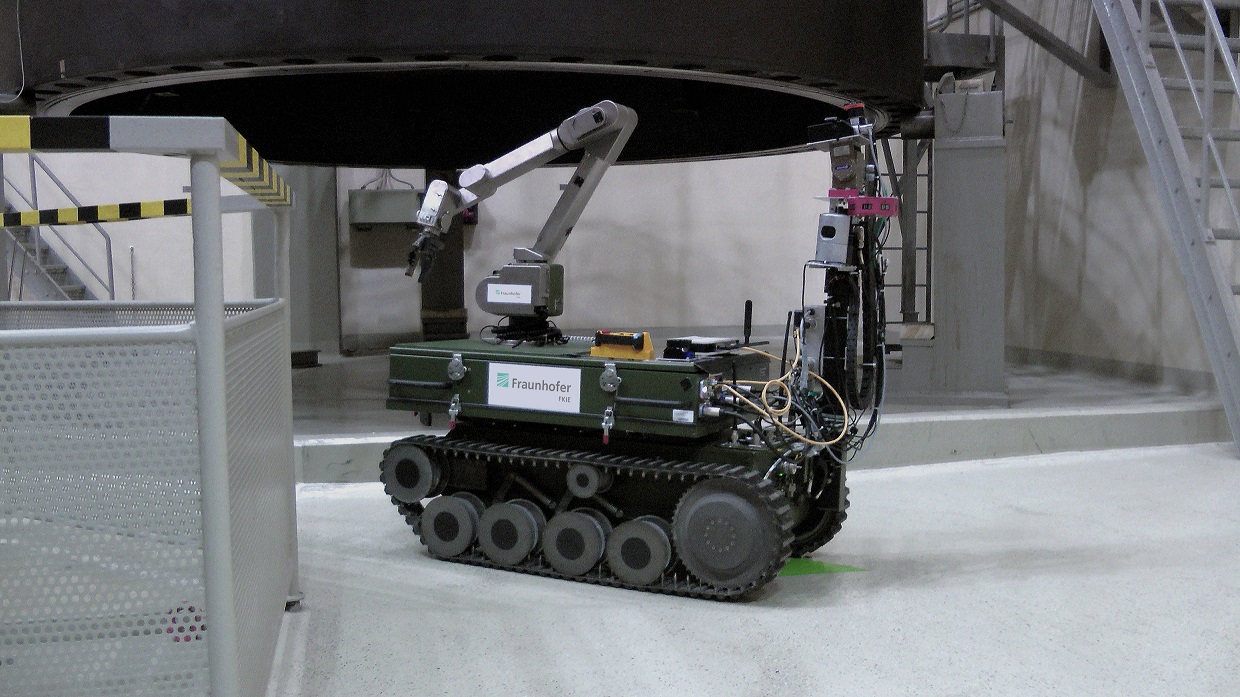

Bei Aufgaben, die für Menschen ein zu hohes Risiko bedeuten, unterstützen Roboter. So beispielsweise im Bereich der CBRNE-Aufklärung. CBRNE steht für »Chemical, Biological, Radiological, Nuclear and Explosive«. Darunter fallen beispielsweise auch aggressive Gefahrstoffe und radioaktive Verstrahlung, welche die Streit- und polizeilichen Sicherheitskräfte im Einsatzfall vor extreme Herausforderungen stellen. Eine Gefahr für Leib und Leben kann hierbei trotz richtiger Ausrüstung und intensiver Schulung nie vollkommen ausgeschlossen werden. Roboter, die mit CBRNE-Sensorik und autonomen Assistenzfunktionen ausgestattet sind, übernehmen hier.

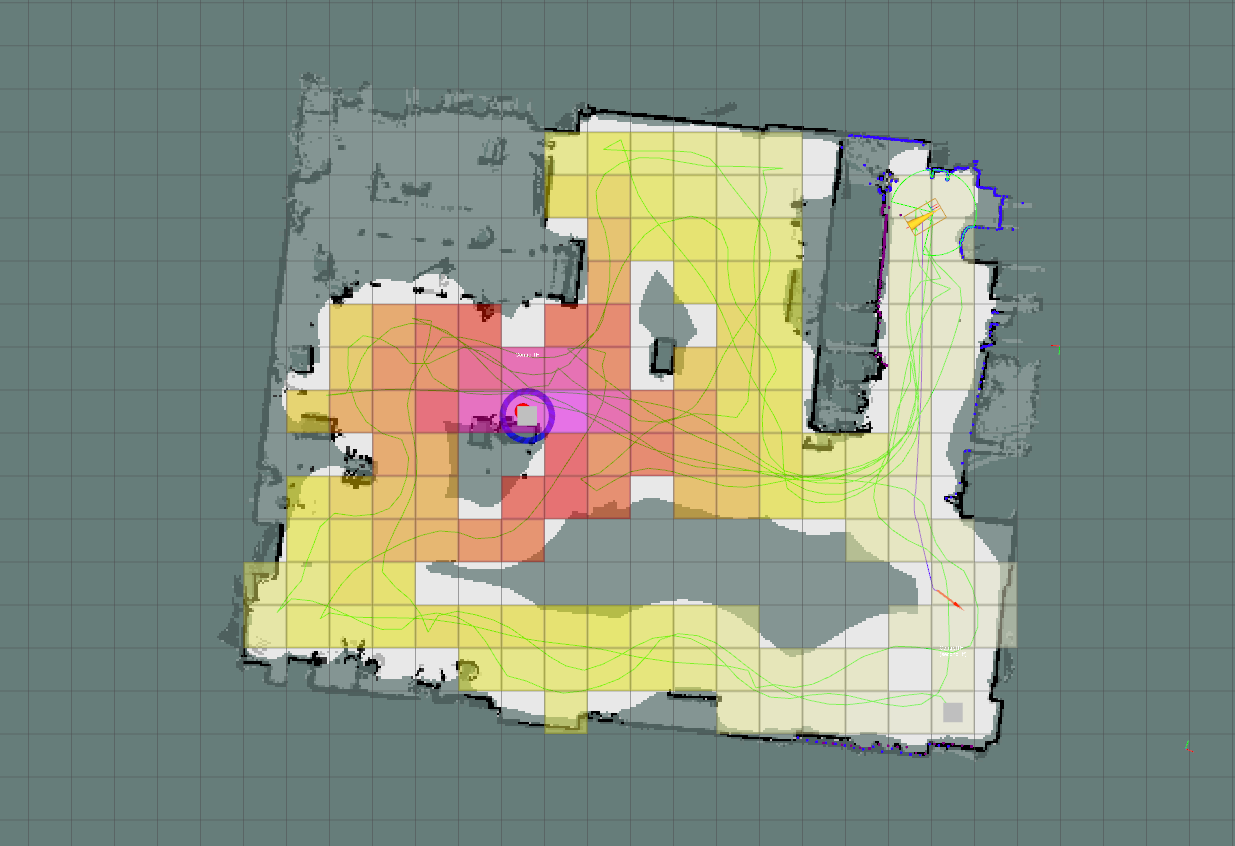

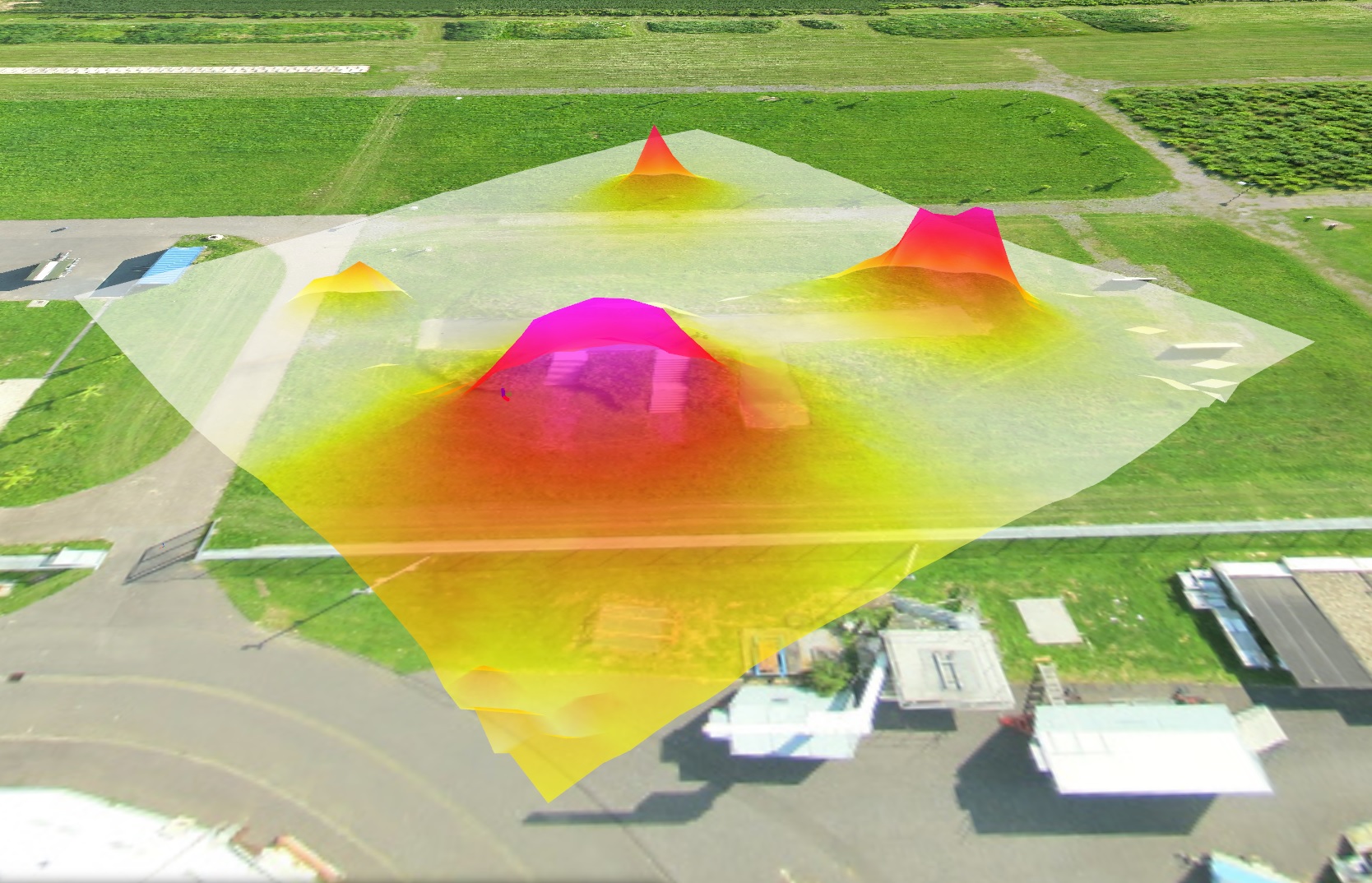

Unterstützt von der Bundeswehr erforscht die Abteilung »Kognitive Mobile Systeme« die intelligente Kombination von CBRNE-Aufklärungssensorik, Navigationsstrategien und Geodatenverarbeitung. Zudem befasst sie sich mit der Entwicklung intelligenter Assistenzfunktionen, die eine entfernte Steuerung von Robotern deutlich einfacher und intuitiver gestalten oder Teilaufgaben sogar vollkommen automatisiert erledigen.